Jaringan Syaraf Tiruan [2]: Model McCulloh-Pitts dan Hebb

Summary

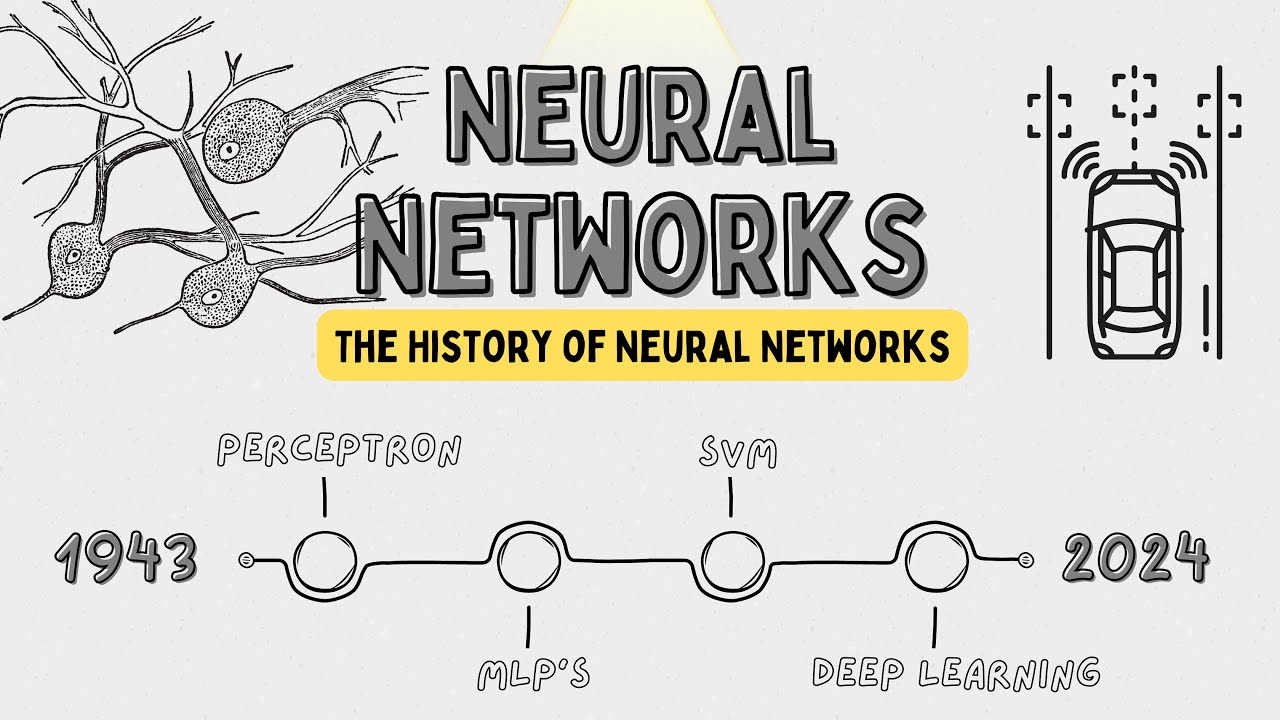

TLDRThe video introduces neural networks, starting with the McCulloch-Pitts model, developed in 1943, highlighting its activation functions and limitations. It explains how the model works for simple logic functions like AND and OR but struggles with complex inputs. The Hebbian learning model is introduced as an enhancement, adding a bias term and enabling supervised learning through weight adjustments. The video also demonstrates how these models can recognize patterns, such as letters, using bipolar data and supervised learning. It concludes by encouraging further exploration of neural networks through training and testing methods.

Takeaways

- 🧠 The video begins by discussing basic neural networks and the progression to different models used in AI.

- 👨🔬 The first model introduced is the McCulloch-Pitts model, proposed in 1943 by Warren McCulloch and Walter Pitts, often referred to as Threshold Logic Neurons (TLN).

- ⚙️ One of the key limitations of the McCulloch-Pitts model is that it requires manual adjustment of weights and thresholds, which limits its application in complex problems.

- 🔢 The McCulloch-Pitts model uses binary inputs and can handle simple logic gates like AND and OR functions, but fails with non-binary or multi-input problems.

- 🔄 To improve the McCulloch-Pitts model, the Hebbian learning model was introduced, which automates weight and bias adjustments during training.

- 💡 Hebbian learning is a supervised learning model proposed by Donald Hebb in 1949, and it enhances the neural network by adjusting weights and biases based on inputs and outputs.

- ⚖️ The Hebbian model introduces bias values in addition to weights, and these are adjusted continuously until the desired output matches the target.

- 🔍 A sample application of the Hebbian model involves binary inputs with values such as +1 and -1, allowing the network to learn patterns like logic gates and classify complex data.

- ✍️ The video explains how to train and test the Hebbian model for pattern recognition, including training the network to recognize shapes like 'T' and 'O' using matrix representation.

- 📊 The script emphasizes the importance of initializing weights and biases in the Hebbian model before training and continuously adjusting them to improve accuracy in pattern recognition.

Q & A

What is the main characteristic of the McCulloch-Pitts model?

-The main characteristic of the McCulloch-Pitts model is its use of a threshold activation function. The weights and threshold values are always constant, and it is primarily used for simple logical functions.

What is a key limitation of the McCulloch-Pitts model?

-A key limitation of the McCulloch-Pitts model is that it requires manual adjustment of weights through trial and error, making it inefficient for complex problems with more than two inputs or non-binary data.

For what type of logic functions can the McCulloch-Pitts model be used?

-The McCulloch-Pitts model can be used for simple logic functions such as AND and OR, as demonstrated through truth tables in the script.

How does the Hebb model differ from the McCulloch-Pitts model?

-The Hebb model differs from the McCulloch-Pitts model by introducing a bias and utilizing supervised learning. It updates the weights and biases automatically based on learning, which improves its ability to handle more complex tasks.

What is the primary purpose of the bias in the Hebb model?

-The primary purpose of the bias in the Hebb model is to adjust the neuron's output by adding a constant value to the weighted sum of inputs, ensuring the output aligns with the target values.

How are weights updated in the Hebb model?

-In the Hebb model, weights are updated continuously by adding the product of the input value and the target output to the current weight. This process continues until the desired output is achieved.

What kind of data representation is used in the Hebb model?

-The Hebb model uses bipolar data representation, where input and output values can be either +1 or -1, rather than binary (0 or 1).

What example is given to demonstrate the Hebb model's learning process?

-An example provided is the learning of the AND logic function using bipolar input representation. The weights and biases are adjusted for four different data points to achieve the correct output.

What is the significance of the pattern recognition task in the Hebb model?

-The pattern recognition task illustrates how the Hebb model can be used to identify specific shapes or patterns (e.g., 'T' and 'P' shapes) by training the model to recognize patterns using bipolar representation.

What is the final result of testing the Hebb model on new input patterns?

-The final result of testing the Hebb model is that it successfully recognizes the third pattern as being more similar to the 'T' shape from the training set, demonstrating the model's ability to generalize from learned patterns.

Outlines

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowMindmap

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowKeywords

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowHighlights

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowTranscripts

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowBrowse More Related Video

[JST INFORMATIKA UNINDRA] Grup 2 Kelas X8C | Tentang McCulloch Pitts

Deep Learning(CS7015): Lec 2.1 Motivation from Biological Neurons

Neural Networks Explained: From 1943 Origins to Deep Learning Revolution 🚀 | AI History & Evolution

What is Deep Learning? (DL 01)

COMO a INTELIGÊNCIA ARTIFICIAL realmente FUNCIONA?

Deep Learning(CS7015): Lec 2.3 Perceptrons

5.0 / 5 (0 votes)