AGI: solved already?

Summary

TLDR在这段对话中,Janus与Roman Yampolsky博士讨论了人工智能的当前状态和未来前景。Yampolsky认为,尽管顶级个体在某些领域仍然超越AI,但平均而言,当前AI的性能已经在多个任务上超越了普通人的智能,并且这种差距正在迅速缩小。他们讨论了AGI(人工通用智能)的定义,以及AI如何可能在三到五年内实现。此外,他们还探讨了AI发展对社会的潜在影响,包括技术失业和文化危机,以及对于AI安全和监管的必要性。Yampolsky强调,开发无法控制的超级智能系统是非常危险的,我们需要在继续发展之前确保有有效的安全机制。

Takeaways

- 🧠 当前AI在各项任务上的平均表现已经超越了普通人类的智能,尽管在许多领域顶尖个体仍然领先于AI,但这一差距正在迅速缩小。

- 🌟 人工智能的通用性(Universality)是其超越人类的关键因素,AI可以执行多种任务,如语言交流、写作、艺术创作和游戏等。

- 📈 人工智能的发展速度非常快,几乎每周都有新模型和新能力的出现,尽管进步看起来不是直线上升,但从长远来看,发展曲线非常陡峭。

- 🔧 从工具型AI(Tool AI)向代理型AI(Agent AI)的转变是关键的转折点,代理型AI具有自己的计划、目标,并且能够创建额外的计划和目标。

- 🤖 随着AI的发展,机器人和自动化技术的进步将导致体力劳动和脑力劳动的价格趋近于零,这可能会对社会结构和经济产生深远影响。

- 🏭 技术失业可能不再是一个短期问题,而是迫在眉睫的现实,所有工作都有可能被自动化,这包括低技能和高技能的职位。

- 🚀 人工智能的快速发展可能在3到5年内达到人类智能水平(AGI),这对于社会、文化和经济都是一个巨大的转变。

- 🛑 目前对于如何应对AI带来的大规模失业和社会变革,社会还没有充分的准备和计划。

- 🤖 意识(Consciousness)可能不是AGI的必要条件,系统可以在没有自我意识的情况下理解和优化其在世界中的作用。

- 🔮 未来3到5年内,AI将继续发展,变得更加强大,但这种发展是不可预测的,因为它超出了人类的理解范围。

- 👮♂️ 使用AI来监管AI的想法存在问题,因为低级智能难以控制更高级的智能,而且目前还没有能够确保AI安全的方法。

Q & A

当前的人工智能在所有可能的任务上的平均表现是否已经超越了普通人类的智能?

-根据脚本内容,当前的人工智能在各种任务上的平均表现已经超越了普通人类的智能,尽管在许多领域顶尖的个体仍然超越了人工智能。

什么是AGI(人工通用智能)?

-AGI指的是能够在任何环境中胜出的系统的能力,它不是狭隘的系统,而是具有通用性和普遍性的智能,超越了典型人类的预期能力。

为什么我们对人类的评价很高,即使他们的平均表现可能并不令人印象深刻?

-我们倾向于认为人类的表现很出色,但事实上,如果与普通人互动,你会发现很多人的表现低于平均水平。这可能是因为每个人都认为自己在平均水平之上,而实际上并非如此。

人工智能的发展速度有多快,我们是否已经接近奇点(Singularity)?

-人工智能的发展速度非常快,每周都有新模型和新能力的出现。虽然进步看起来不是直线上升,但如果从70年的研究历史来看,大部分进步都发生在最近5%的时间里,这意味着进步的曲线正在变得越来越陡峭。

工具型AI和代理型AI之间有什么区别?

-工具型AI是根据指令执行任务的,而代理型AI具有自己的计划和目标,并且能够创建额外的计划和目标,这是游戏规则的改变者。

为什么说AGI的发展可能会导致所有工作都被自动化?

-AGI具有极高的智能和能力,可以执行各种任务,包括那些需要高技能和创造力的工作。随着技术的进步,甚至物理劳动,如管道工等,也可能被自动化。

如果所有工作都被自动化,人类将如何找到生活的意义?

-如果所有工作都被自动化,人类需要找到与工作无关的新方式来创造意义。这可能是一个文化危机,我们目前还没有准备好应对。

为什么说我们现在正处于一个文化范式转变的时期?

-随着AGI的发展,我们对工作、思考、职业和经济结构的理解都将发生根本性的变化。这种转变需要社会逐步适应,而不能一夜之间完成。

当前人工智能领域的一些辞职事件是否与对AGI的恐惧有关?

-虽然不能确定,但有可能一些安全专家因为担心AGI的发展和潜在风险而选择辞职。他们可能认为从内部进行风险缓解比简单地辞职更有帮助。

为什么说开发超级智能可能是世界上最愚蠢的事情?

-开发一个我们无法控制的真正通用且能力更强的系统,就像是在制造我们的替代品。除非有一套有效的安全机制,否则继续开发更强大的通用AI是不明智的。

意识是否是AGI的一个必要条件?

-不一定。AGI可能不需要有自我意识或对自身存在的认识,只要它能够在世界模型中理解自己是一个代理,并且理解自己如何影响世界以及世界如何影响它。

未来三到五年内,AI领域可能会有哪些发展?

-未来几年内,我们可以预期会有更多的、能力更强的模型被发布。这些模型将变得越来越能干,最终可能会超越人类的智能。

AI自我监管是否是一个可行的策略?

-AI自我监管可能是一个挑战,因为较低级别的智能很难无限期地控制较高级别的智能。此外,我们还没有看到任何已经对齐的'警察AI',这意味着我们无法验证和确保它们的安全。

Outlines

此内容仅限付费用户访问。 请升级后访问。

立即升级Mindmap

此内容仅限付费用户访问。 请升级后访问。

立即升级Keywords

此内容仅限付费用户访问。 请升级后访问。

立即升级Highlights

此内容仅限付费用户访问。 请升级后访问。

立即升级Transcripts

此内容仅限付费用户访问。 请升级后访问。

立即升级浏览更多相关视频

6. Layers of Mental Activities

7. Layered Knowledge Representations

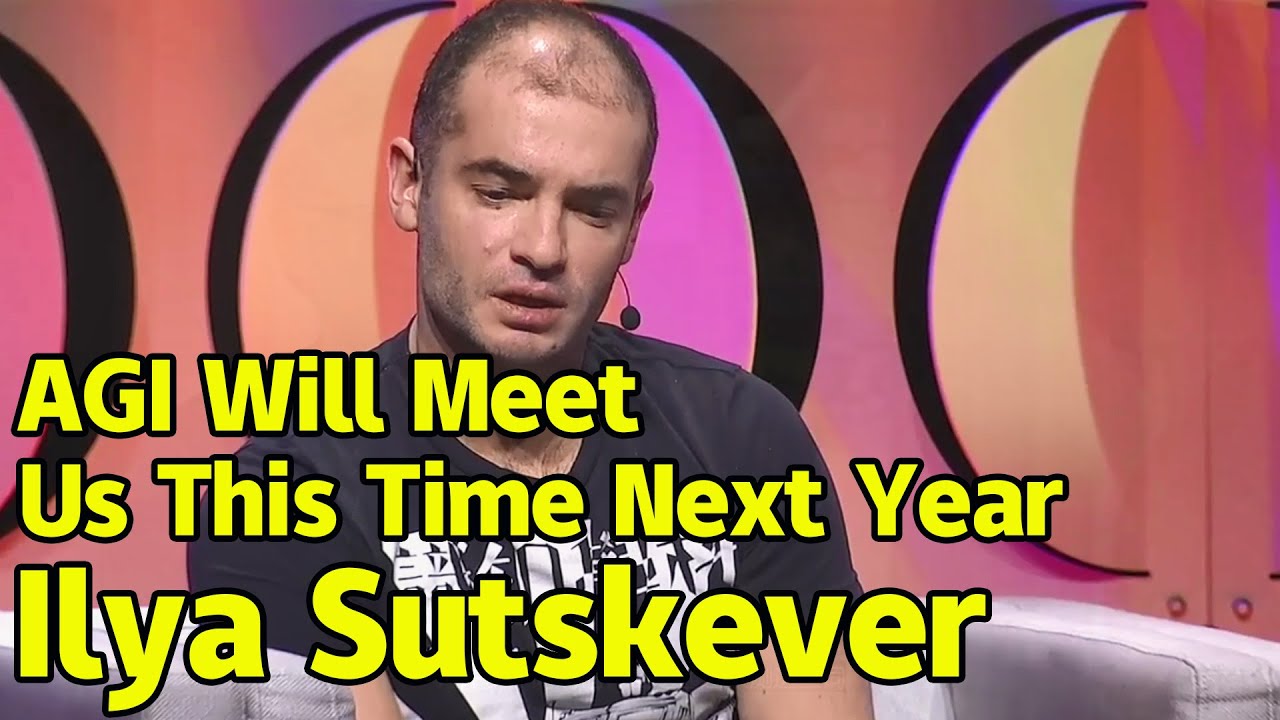

Ilya Sutskever | The birth of AGI will subvert everything |AI can help humans but also cause trouble

Ray Kurzweil & Geoff Hinton Debate the Future of AI | EP #95

The bull and bear cases for Tesla's position in the Magnificent 7

Ilya Sutskever (OpenAI Chief Scientist) - Building AGI, Alignment, Spies, Microsoft, & Enlightenment

5.0 / 5 (0 votes)