【生成式AI導論 2024】第18講:有關影像的生成式AI (下) — 快速導讀經典影像生成方法 (VAE, Flow, Diffusion, GAN) 以及與生成的影片互動

Summary

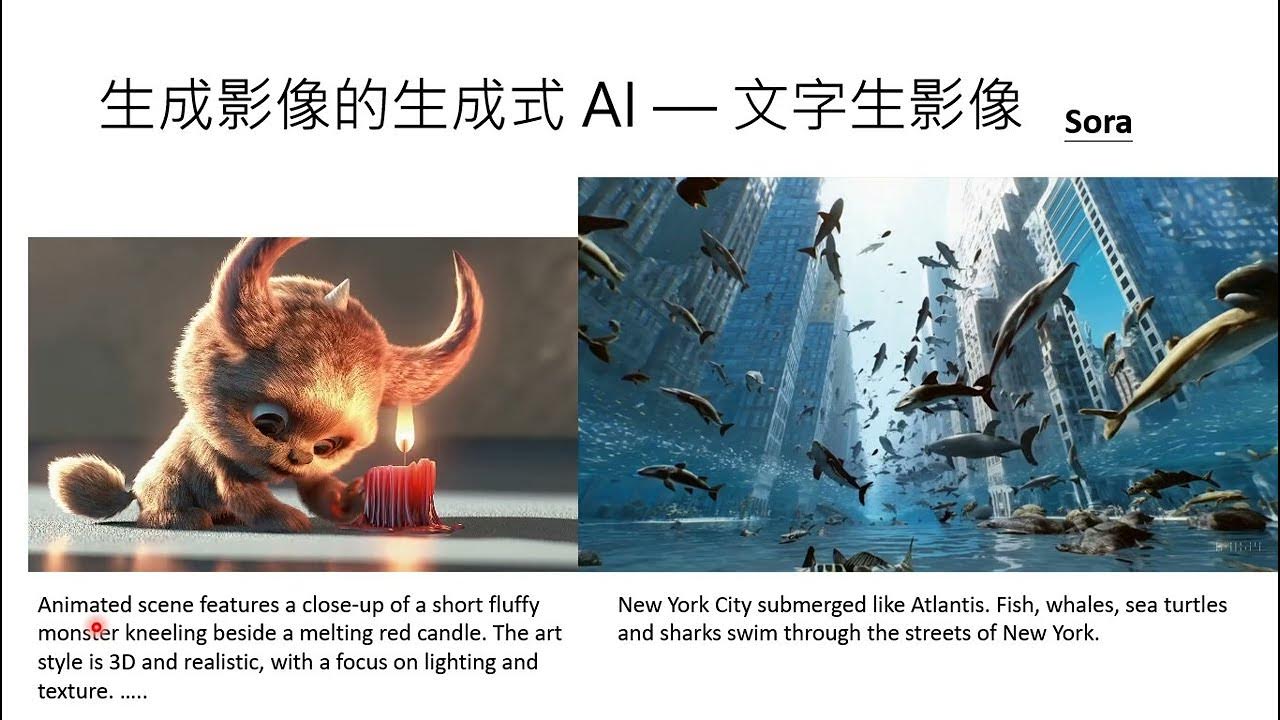

TLDR本文稿介绍了几种经典的影像生成方法,包括变分自编码器(VAE)、基于流的模型、扩散模型和生成对抗网络(GAN)。特别提到了扩散模型在生成高清图像方面的应用,以及Transformer架构在处理文字到图像转换中的挑战。文中还探讨了如何通过训练信息抽取模型和生成模型来解决文本描述与图像生成之间的不一致问题,并展望了人工智能生成影像与人类互动的未来可能性,例如通过Genie模型实现交互式环境生成。

Takeaways

- 🌟 介绍了几种经典的图像生成方法,包括变分自编码器(VAE)、基于流的模型(Flow-Based Model)、扩散模型(Diffusion Model)和生成对抗网络(GAN)。

- 📈 Sora 使用的是扩散模型,这种模型能够从大量噪声中生成高清图像。

- 🔍 讨论了在图像生成中,Transformer 架构由于其简单性而变得非常流行,尽管过去常用 CNN。

- 🤖 描述了 Transformer 在训练时可能遇到的问题,比如输入的文本可能无法完整描述图像,导致生成的图像出现多样性。

- 🔑 提出了通过增加额外信息来辅助图像生成模型,例如指定狗的品种或背景环境,以解决输入文本描述不足的问题。

- 🎯 探讨了如何通过训练信息抽取模型来辅助图像生成,抽取文本未描述的信息,并将其提供给图像生成模型。

- 🔄 介绍了自编码器(AutoEncoder)的概念,其中包括编码器(Encoder)和解码器(Decoder),以及它们如何共同训练以生成图像。

- 👾 说明了在实际使用图像生成模型时,如何通过随机生成的向量(脑补信息)来生成图像,这在 VAE 模型中尤为重要。

- 🛠️ 讨论了扩散模型的工作原理,即通过反复去噪(Denoise)来逐步生成清晰的图像。

- 🔮 描述了 GAN 的训练过程,包括生成器(Generator)和鉴别器(Discriminator)的交替训练,以及它们如何共同提高生成图像的质量。

- 🎮 提出了 Genie 模型的概念,它能够根据用户输入的动作来生成交互式的游戏环境,展示了人工智能在游戏和模拟环境中的应用潜力。

Q & A

什么是变分自编码器(Variational Autoencoder, VAE)?

-变分自编码器是一种生成模型,它通过编码器(Encoder)将输入数据转换成潜在空间的表示,然后通过解码器(Decoder)从这个潜在表示中重建数据。VAE在生成新样本时,会从潜在空间中随机采样。

Flow-Based Model与VAE有何不同?

-Flow-Based Model与VAE类似,但区别在于Flow-Based Model只训练一个可逆的解码器(invertible decoder),这个解码器同时充当编码器的角色,通过学习如何将数据从一个形式转换到另一个形式,再转换回来。

Diffusion Model是如何生成图像的?

-Diffusion Model通过逐步去除噪声(de-noise)来生成图像。这个过程通常需要多次迭代,每次迭代都会使图像更加清晰,直到最终生成高清晰度的图像。

生成对抗网络(Generative Adversarial Network, GAN)的基本原理是什么?

-GAN包含两个网络:生成器(Generator)和判别器(Discriminator)。生成器生成图像,判别器评估图像的真实性。两者相互竞争,生成器不断学习如何产生更真实的图像,而判别器则学习如何更好地区分真实图像和生成图像。

为什么Transformer在图像生成中变得非常流行?

-Transformer因其能够处理长距离依赖关系的能力而在图像生成中变得流行。它可以将文本转换为图像的多个部分(patches),然后有效地组合这些部分生成完整的图像。

在图像生成中,如何处理文本描述与实际图像之间的差异?

-可以通过训练一个信息抽取模型来补充文本描述中未提及的信息,然后将这些信息提供给图像生成模型,帮助模型更准确地生成与文本描述相匹配的图像。

什么是AutoEncoder框架,它在图像生成中扮演什么角色?

-AutoEncoder框架包括编码器(Encoder)和解码器(Decoder)。编码器从输入数据中抽取信息,解码器则尝试从这些信息中重建数据。在图像生成中,AutoEncoder可以用来训练模型,使其能够根据部分信息生成完整的图像。

Genie模型是如何实现交互式环境生成的?

-Genie模型通过读取游戏画面和玩家的输入动作,预测并生成下一帧画面。它使用潜在动作(Latent Action)的概念,即使没有确切的玩家输入,也能通过模型预测动作,实现交互式的游戏环境生成。

GAN和Diffusion Model在生成图像时有什么本质区别?

-GAN通过训练生成器和判别器的对抗过程来生成图像,而Diffusion Model则是通过逐步去除噪声来生成图像。GAN更侧重于判别器的评价,而Diffusion Model侧重于噪声的减少过程。

如何理解GAN中的判别器(Discriminator)和奖励模型(Reward Model)的关系?

-在GAN中,判别器评估生成图像的质量,而在强化学习中的奖励模型则提供对答案好坏的直接评价。两者都用于指导生成模型的训练,但判别器在GAN中是通过与生成器的对抗学习来提升评价能力,而奖励模型通常是基于人工标注来训练。

Outlines

此内容仅限付费用户访问。 请升级后访问。

立即升级Mindmap

此内容仅限付费用户访问。 请升级后访问。

立即升级Keywords

此内容仅限付费用户访问。 请升级后访问。

立即升级Highlights

此内容仅限付费用户访问。 请升级后访问。

立即升级Transcripts

此内容仅限付费用户访问。 请升级后访问。

立即升级浏览更多相关视频

What are Diffusion Models?

Let's build GPT: from scratch, in code, spelled out.

【生成式AI導論 2024】第17講:有關影像的生成式AI (上) — AI 如何產生圖片和影片 (Sora 背後可能用的原理)

Text-to-GRAPH w/ LGGM: Generative Graph Models

CS480/680 Lecture 19: Attention and Transformer Networks

Lecture 1.3 — Some simple models of neurons — [ Deep Learning | Geoffrey Hinton | UofT ]

5.0 / 5 (0 votes)