Large Language Models (LLMs) - Everything You NEED To Know

Summary

TLDR本视频深入探讨了大型语言模型(LLMs)的现状、挑战及应用。视频讨论了偏见、幻觉、资源消耗等问题,并探讨了它们在翻译、编程、内容创作等多个领域的广泛应用。同时,视频也关注了AI在伦理方面的挑战,包括版权问题、误用风险和工作岗位的替代。此外,视频介绍了最新的技术进展,如知识蒸馏、检索增强生成(RAG)、专家混合等。最终,视频提醒人们关注AGI带来的潜在风险及对人类社会的影响。

Takeaways

- 😀 LLMs(大型语言模型)会受到训练数据中的偏见影响,这可能导致有害结果。部分公司通过加入审查机制来限制这些偏见,但这仍然是一个有争议的话题。

- 😀 LLM的知识截止时间是训练时的数据更新点,尽管像ChatGPT这样的模型开始能够访问实时数据(例如浏览网页、推文),但这些功能还存在很多技术难题。

- 😀 LLMs存在“幻觉”问题,即有时它们会自信地给出错误的答案,尽管这些回答并不准确。

- 😀 训练LLM需要大量硬件资源,导致其开发和维护成本非常高。

- 😀 尽管一些AI公司声称没有使用版权材料来训练其模型,但已经发现这种声明并不属实,目前有许多诉讼案件正在法院进行。

- 😀 LLM的应用不仅限于聊天机器人,它们在翻译、编程、摘要、写作、图像和视频创作等多个领域都有广泛的用途。

- 😀 知识蒸馏(Knowledge Distillation)允许从大型模型中提取重要知识,并将其传递给较小且高效的模型,这使得AI可以在普通消费者设备上运行。

- 😀 检索增强生成(RAG)技术使得LLM能够查询外部信息,超越其原始训练数据,从而增加了模型的能力。

- 😀 LLMs可能被用于恶意行为,如诈骗、虚假信息传播和创造有害内容,这对社会产生严重影响。

- 😀 AGI(人工通用智能)的发展可能会导致AI独立思考,带来安全风险,因此需要确保AI的“对齐”问题,即使得AI的目标与人类利益一致。

- 😀 当前研究的前沿包括事实核查、自主选择专家模型(Mixture of Experts)、多模态输入处理、逐步推理(Slow Thinking)以及更大的上下文窗口和外部记忆,这些都旨在提升LLM的能力和效率。

Q & A

大型语言模型的主要局限性是什么?

-大型语言模型的主要局限性包括:偏见和意见传递,这些偏见来自于其训练数据集;'幻觉'问题,即模型可能会错误地生成自信但错误的信息;计算资源要求高,训练和微调模型需要大量硬件和能源;以及版权和伦理问题,许多AI公司未能证明他们的模型没有使用受版权保护的材料。

大型语言模型如何被用于现实世界中?

-大型语言模型不仅可以作为聊天机器人,还可用于语言翻译、编程助手、摘要生成、论文写作、图像和视频生成等多种任务。它们可以帮助解决几乎所有人类使用计算机能处理的认知任务。

什么是知识蒸馏,它如何改善大型语言模型?

-知识蒸馏是一种技术,旨在将大型模型中的关键知识转移到较小的高效模型中。通过这种方式,较小的模型可以获得大型模型的知识,同时保持高效能,甚至可以在普通的消费硬件上运行,如智能手机等设备。

什么是检索增强生成(RAG),它如何影响大型语言模型?

-检索增强生成(RAG)是通过允许大型语言模型在外部数据中进行查询,从而增强其生成能力的一种技术。这使得模型能够访问超出训练数据之外的额外信息,进一步提高其表现和适应能力。

大型语言模型的'幻觉'问题是指什么?

-'幻觉'是指大型语言模型有时会自信地提供错误或捏造的信息。它们可能在没有任何事实依据的情况下给出答案,并且通常表现出极高的自信,尽管这些信息可能完全不准确。

在训练大型语言模型时,存在哪些伦理问题?

-在训练大型语言模型时,伦理问题包括模型可能会使用受版权保护的材料,而这些材料未获得许可。此外,模型还可能被用于恶意活动,如诈骗、虚假信息传播等,造成社会和经济的潜在危害。

大型语言模型可能会对哪些行业造成影响?

-大型语言模型可能会对律师、作家、程序员等多个行业造成严重影响。任何依赖计算机进行思考和任务处理的职业都可能面临由AI带来的变革和挑战,可能导致大量工作岗位的流失。

什么是AGI(人工通用智能),它可能带来的挑战是什么?

-AGI指的是能够自主思考并超越人类智力的人工智能。AGI的出现可能带来极大的伦理和控制挑战,特别是在确保AI的目标与人类一致的方面,即所谓的对齐问题。

未来有哪些技术可以提高大型语言模型的性能?

-未来的技术进展包括:让大型语言模型能够自行进行事实核查,通过从网络获取信息;多专家混合技术,使多个专门化的模型协同工作,提高效率;以及多模态输入处理,能够同时处理语音、图像和视频等多种数据源。

大型语言模型如何进行推理改进?

-推理改进正在成为研究重点之一。新的技术(如Orca)使得大型语言模型能够逐步思考问题,而不是直接跳到结论。这种方法可以提高模型在复杂问题上的推理能力,避免草率的决策。

Outlines

此内容仅限付费用户访问。 请升级后访问。

立即升级Mindmap

此内容仅限付费用户访问。 请升级后访问。

立即升级Keywords

此内容仅限付费用户访问。 请升级后访问。

立即升级Highlights

此内容仅限付费用户访问。 请升级后访问。

立即升级Transcripts

此内容仅限付费用户访问。 请升级后访问。

立即升级浏览更多相关视频

DEEPSEEK DROPS AI BOMBSHELL: A.I Improves ITSELF Towards Superintelligence (BEATS o1)

GPT-4o 背後可能的語音技術猜測

Agentic AI: The Future is here?

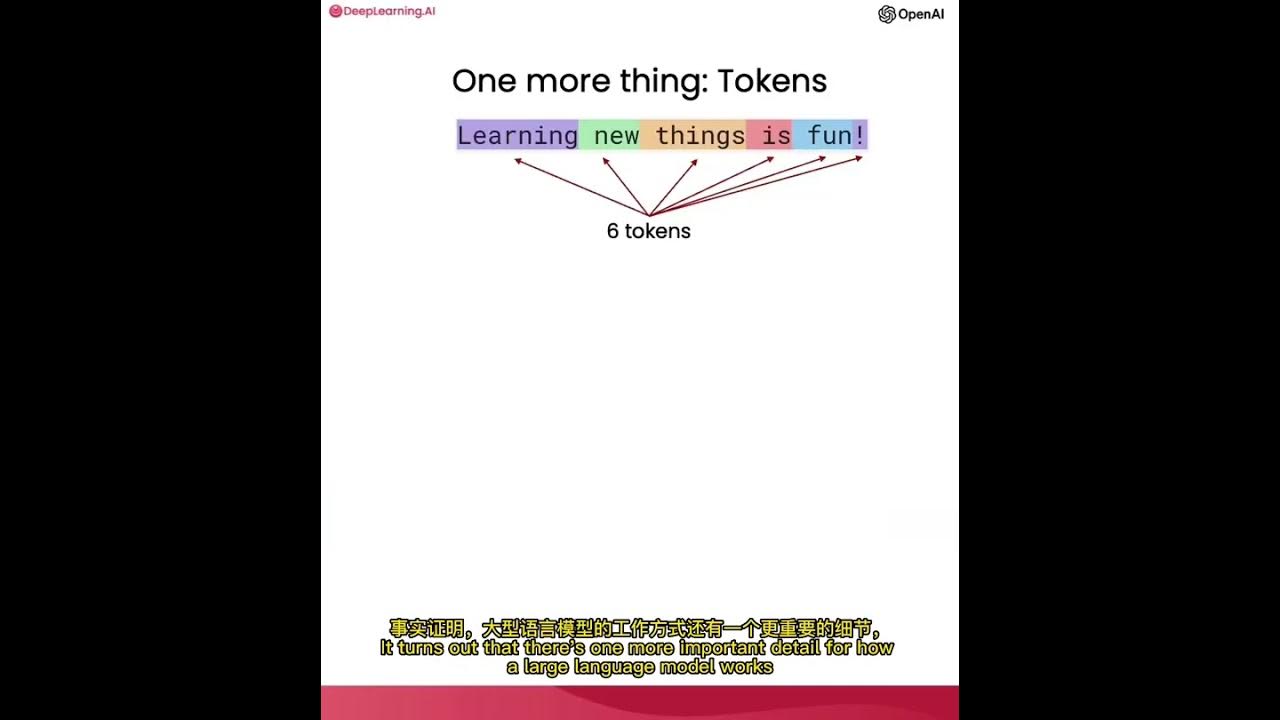

使用ChatGPT API构建系统1——大语言模型、API格式和Token

Augmentation of Data Governance with ChatGPT and Large LLMs

Ilya Sutskever | AI neurons work just like human neurons | AGI will be conscious like humans

Python Vs C++ Vs Java!

5.0 / 5 (0 votes)