84. Databricks | Pyspark | Azure Data Factory + Azure Databricks: Execute Notebook Via ADF

Summary

TLDREn este video se explica cómo activar un notebook de Databricks desde Azure Data Factory (ADF), una práctica común en ingeniería de datos en la nube. El contenido cubre desde la comprensión básica de ADF como herramienta de orquestación y programación, hasta la integración con Databricks mediante linked services y clusters. Se muestra un ejemplo práctico de extracción de datos desde Azure SQL y su escritura en Azure Data Lake Storage, detallando la configuración de notebooks, parámetros, triggers y ejecución. El video ofrece una guía paso a paso, ideal para quienes buscan automatizar pipelines combinando servicios de Azure de manera eficiente y flexible.

Takeaways

- 😀 Azure Data Factory (ADF) es una herramienta de orquestación de ETL sin código, que permite programar y coordinar procesos en la nube de Azure.

- 😀 Databricks es una herramienta basada en código para realizar trabajos ETL, mientras que ADF permite integrarlo en flujos más amplios de manera visual.

- 😀 ADF puede usarse para disparar notebooks de Databricks cuando se requiere mezclar actividades de diferentes servicios de Azure o procesar datos basados en eventos.

- 😀 Existen tres tipos de disparadores en ADF: programados, basados en eventos y de ventana temporal, que permiten flexibilidad en la ejecución de pipelines.

- 😀 Para integrar ADF con Databricks, se debe crear un 'Linked Service', que funciona como la conexión entre ambos servicios.

- 😀 Es necesario seleccionar un cluster de Databricks: puede ser un cluster de trabajo (job cluster) o un cluster de propósito general (all-purpose cluster).

- 😀 Los notebooks de Databricks pueden recibir parámetros de entrada y salida, que deben configurarse en ADF si son necesarios para el proceso ETL.

- 😀 Un ejemplo práctico consiste en extraer datos de una tabla de Azure SQL ('dbo.emp') y escribirlos en Azure Data Lake Storage mediante un punto de montaje.

- 😀 La ejecución de un pipeline en ADF puede hacerse en modo debug para pruebas individuales o mediante triggers para ejecución recurrente o basada en eventos.

- 😀 Tras la ejecución exitosa, los datos se escriben en ADLS con un folder que incluye un timestamp, lo que permite mantener un historial de versiones de los datos procesados.

Q & A

¿Qué es Azure Data Factory (ADF) y para qué se utiliza?

-ADF es una herramienta de orquestación visual de Azure que permite crear pipelines ETL sin necesidad de código, además de actuar como un programador de tareas para automatizar flujos de trabajo en la nube.

¿Cuál es la diferencia principal entre Databricks y ADF?

-Databricks es una plataforma basada en código para ejecutar tareas de procesamiento y análisis de datos, mientras que ADF es una herramienta visual y sin código que permite orquestar flujos de trabajo y programar actividades, incluyendo notebooks de Databricks.

¿Cuándo es útil integrar ADF con un notebook de Databricks?

-Es útil cuando se necesita combinar actividades de ADF con notebooks de Databricks o cuando se requiere un disparo basado en eventos, como la llegada de un archivo, que no es fácil de manejar directamente desde Databricks.

¿Qué es un Linked Service en ADF?

-Un Linked Service es un objeto de conexión en ADF que permite al pipeline comunicarse con otros servicios, como Databricks, bases de datos SQL o Azure Data Lake Storage.

¿Cuáles son los tipos de clusters en Databricks y cuándo se usan?

-Existen los clusters de trabajo (job clusters), que se crean y terminan automáticamente para cada tarea, y los clusters de uso general (all-purpose clusters), que son persistentes y se usan de manera interactiva, principalmente en desarrollo.

¿Qué pasos realiza el notebook de ejemplo mencionado en el video?

-1) Configura la conexión JDBC usando Azure Key Vault, 2) Lee datos de una tabla SQL (dbo.emp), 3) Escribe los datos en Azure Data Lake Storage usando un punto de montaje y agrega un timestamp al nombre de la carpeta de salida.

¿Cómo se genera un token de acceso en Databricks para ADF?

-Se genera en Databricks desde User Settings → Generate New Token, se asigna un nombre significativo y una duración, y se copia el token para usarlo en el Linked Service de ADF.

¿Cómo se ejecuta un pipeline de ADF que llama a un notebook de Databricks?

-Se puede ejecutar usando la opción 'Debug' para pruebas inmediatas o mediante un 'Trigger' para programar la ejecución, ya sea una sola vez o de manera recurrente.

¿Qué es un trigger basado en eventos en ADF y por qué es útil?

-Es un disparador que inicia un pipeline automáticamente cuando ocurre un evento específico, como la llegada de un archivo. Es útil para cargas incrementales en tiempo real que Databricks por sí solo no maneja eficientemente.

¿Qué consideraciones deben tenerse al configurar parámetros de entrada y salida en un notebook?

-Si el notebook requiere parámetros, estos deben definirse en la actividad de notebook en ADF. Si no hay parámetros, esta configuración es opcional. Esto asegura que los datos correctos se pasen al notebook durante la ejecución del pipeline.

¿Cuál es la ventaja de usar ADF sobre solo Databricks workflows?

-ADF permite combinar múltiples servicios de Azure en un solo flujo, habilita disparadores basados en eventos y proporciona una interfaz visual para orquestar pipelines, lo que aumenta la flexibilidad y la capacidad de automatización frente a workflows únicamente en Databricks.

Outlines

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowMindmap

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowKeywords

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowHighlights

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowTranscripts

This section is available to paid users only. Please upgrade to access this part.

Upgrade NowBrowse More Related Video

☁ Google Cloud Platform ☁ - Como registrarse y crear nuestro primer proyecto 💡

Azure AZ-900: Understanding Regions and Availability Zones

Proveedores de servicios en la nube | Diferencias entre AWS, AZURE y GCP

04 AWS EC2 y casos de uso

Encriptación de base de datos SQL Server paso a paso

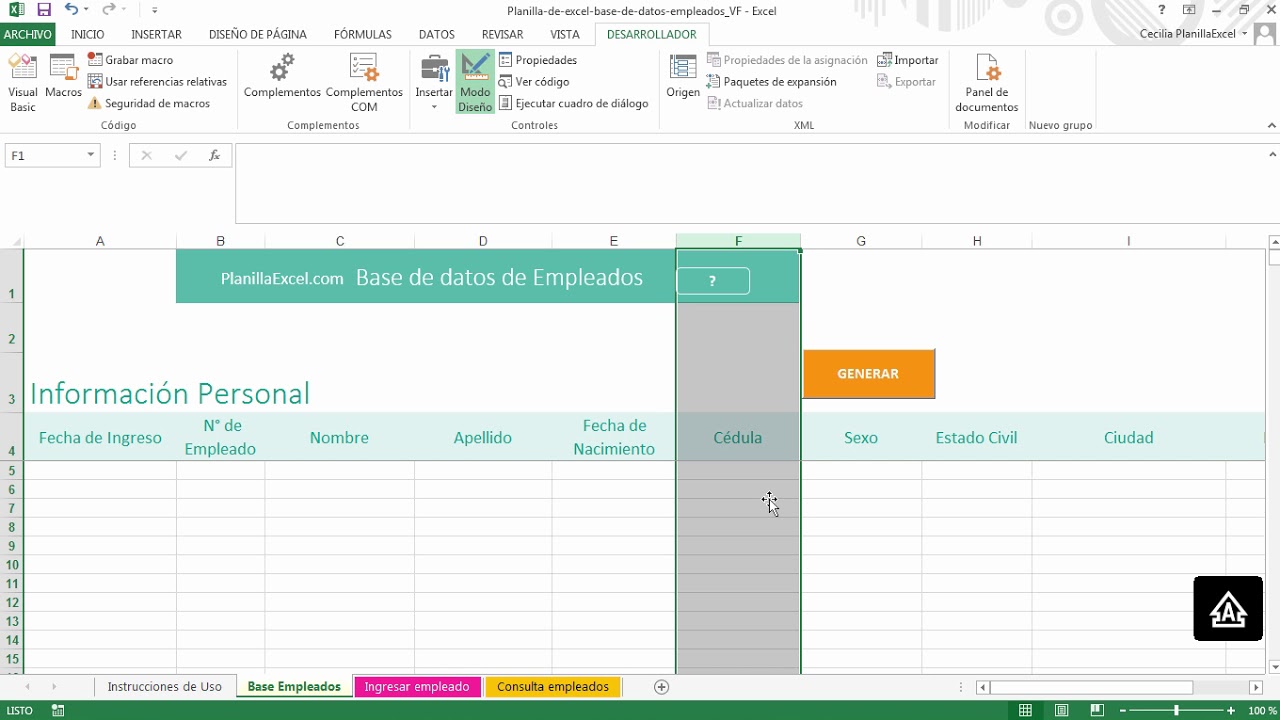

Base de datos de empleados en Excel

5.0 / 5 (0 votes)