Tecnologías de BIG DATA

Summary

TLDREl video destaca cómo las bases de datos tradicionales ya no son suficientes para procesar el creciente volumen de datos en las empresas. Se plantea la necesidad de adoptar tecnologías de procesamiento distribuido y plataformas de Big Data para manejar estos datos de manera eficiente. A través de un curso de 20 horas, se ofrece una visión global sobre Big Data, su almacenamiento en la nube y el procesamiento en clústeres. Además, se explora la importancia de la analítica en la toma de decisiones empresariales. El curso también enseña a desplegar clústeres en la nube de forma sencilla y eficiente.

Takeaways

- 💽 Las bases de datos tradicionales se están volviendo menos eficientes debido al rápido crecimiento de los datos.

- 🚀 Las bases de datos actuales son más rápidas y eficientes, pero no pueden manejar el aumento exponencial de datos sin un cambio de tecnología.

- ⚙️ La solución no es agregar más recursos a las bases de datos existentes, sino cambiar a plataformas de procesamiento distribuido.

- 🌐 Las tecnologías de procesamiento distribuido permiten una escalabilidad prácticamente ilimitada para manejar grandes volúmenes de datos.

- ☁️ La nube juega un papel fundamental en este cambio, permitiendo desplegar clusters de procesamiento de manera eficiente y económica.

- 🗂️ HDFS (Hadoop Distributed File System) es clave para almacenar big data de manera eficiente, especialmente en entornos de nube.

- 🖥️ Las plataformas Hadoop y Spark son fundamentales en el ecosistema de procesamiento de big data, ofreciendo opciones tanto de procesamiento en disco como en memoria.

- 📊 La analítica es el paso final e ineludible en el manejo de big data, permitiendo a las empresas tomar decisiones basadas en datos procesados.

- 📈 Power BI es una herramienta que facilita el análisis de big data, permitiendo a los usuarios no expertos acceder a estas tecnologías.

- 🎓 El curso sobre tecnologías de big data promete una visión global en 20 horas, ayudando a los usuarios a comprender y aplicar estas tecnologías en su día a día.

Q & A

¿Por qué las bases de datos tradicionales parecen ser menos eficientes hoy en día?

-Aunque las bases de datos son cada vez más rápidas y eficientes, el crecimiento exponencial de los datos las sobrecarga. Si seguimos usando herramientas tradicionales para procesar datos masivos, no lograremos resultados óptimos.

¿Cuál es la principal causa del rendimiento lento de las bases de datos según el video?

-El problema principal no es la eficiencia de las bases de datos, sino que los datos crecen a una velocidad mayor que la capacidad de procesamiento de las herramientas tradicionales.

¿Cuál es la solución propuesta para lidiar con el crecimiento de los datos?

-La solución es cambiar a tecnologías de procesamiento distribuido, que permiten un crecimiento prácticamente ilimitado en la capacidad de procesamiento, en lugar de simplemente agregar más recursos a las bases de datos tradicionales.

¿Por qué no es suficiente añadir más recursos a una base de datos tradicional?

-Añadir más recursos no resuelve el problema porque las tecnologías tradicionales no están diseñadas para manejar grandes volúmenes de datos de manera eficiente. Es necesario adoptar nuevas tecnologías adaptadas a estas necesidades.

¿Qué se menciona como el primer paso para mejorar el procesamiento de datos?

-El primer paso es comprender y tener una visión clara de las nuevas tecnologías disponibles, especialmente las herramientas de big data, y cómo pueden ayudarnos a procesar grandes volúmenes de datos.

¿Cómo puede la nube ayudar en el procesamiento de grandes volúmenes de datos?

-La nube permite desplegar clústeres funcionales sin necesidad de aprovisionamiento físico, lo que facilita el procesamiento de miles de millones de registros con un esfuerzo mínimo y altos niveles de abstracción tecnológica.

¿Qué temas principales se cubren en el curso de big data mencionado en el video?

-El curso cubre una introducción al big data, el almacenamiento en la nube usando HDFS, plataformas de procesamiento distribuidas como Hadoop y Spark, y herramientas analíticas como Power BI.

¿Qué es HDFS y por qué es relevante en el contexto de big data?

-HDFS es el sistema de archivos distribuido de Hadoop, diseñado para almacenar y gestionar grandes volúmenes de datos de manera eficiente. Su implementación en la nube ofrece costos reducidos y alta eficacia.

¿Cómo pueden las herramientas de big data acercar el procesamiento a los usuarios de negocio?

-Existen herramientas dentro de los ecosistemas de Hadoop y Spark que permiten a los usuarios de negocio acceder y trabajar con grandes volúmenes de datos sin necesidad de ser expertos en la tecnología subyacente.

¿Cuál es la importancia de la analítica en el proceso de big data según el video?

-La analítica es el último paso del procesamiento de big data. Permite a las empresas obtener información valiosa de los datos procesados y es un componente ineludible para cualquier empresa que maneje grandes volúmenes de datos.

Outlines

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraMindmap

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraKeywords

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraHighlights

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraTranscripts

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraVer Más Videos Relacionados

📤01: ¿Qué son las BASES DE DATOS no relacionales NoSQL? | @Ingenioteka

| Modelos de Base de datos Explicados | Fundamentos de Base de Datos | Tipos de Modelos |

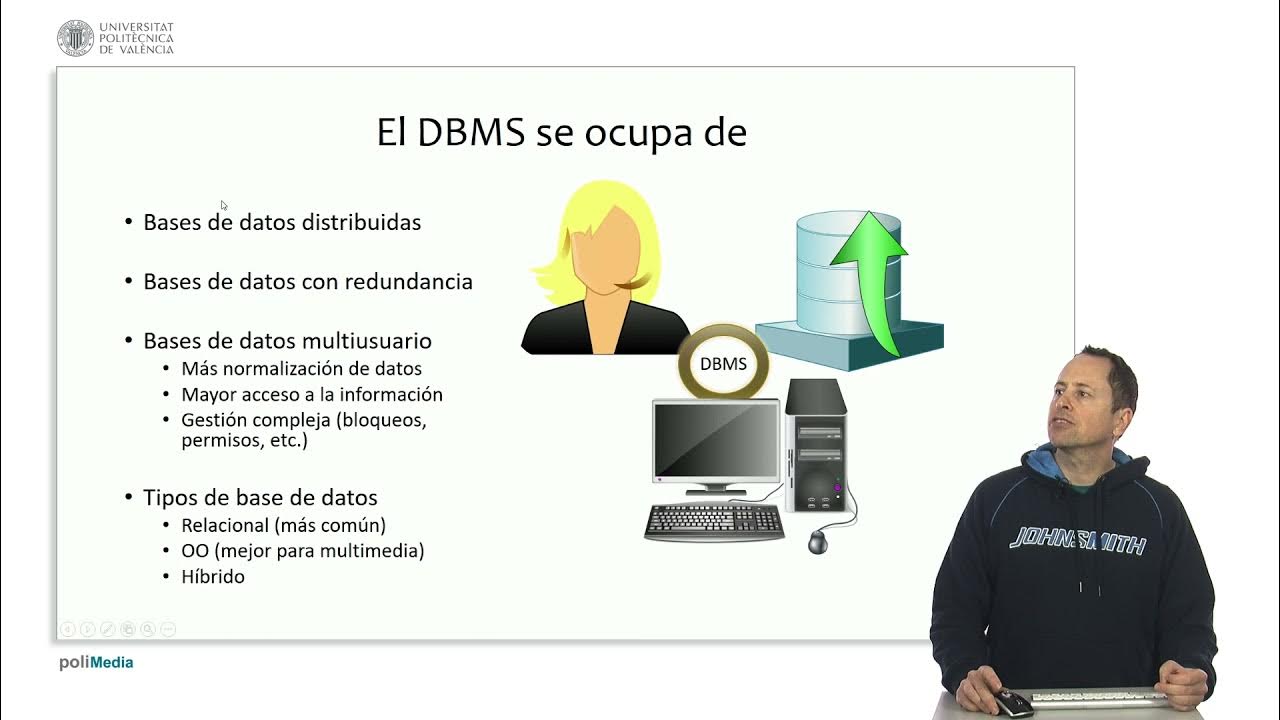

SQL. Sistemas de gestión de bases de datos (DBMS) | 4/25 | UPV

Fundamentos de Inteligencia de Negocios: Bases de Datos y Administración

What is Big Data? - Computerphile

Cómo elegir una base de datos

5.0 / 5 (0 votes)