What is Retrieval-Augmented Generation (RAG)?

Summary

TLDRLes modèles de langage de grande taille (LLM) sont omniprésents, mais ils rencontrent souvent des problèmes de données obsolètes et de manque de sources fiables. Le framework Retrieval-Augmented Generation (RAG) d'IBM Research résout ces défis en permettant aux LLM de récupérer des informations actualisées à partir d'une base de données avant de générer une réponse. Ce processus garantit des réponses plus précises, basées sur des sources primaires, et réduit les hallucinations. RAG améliore également la transparence en permettant au modèle de dire quand il ne connaît pas la réponse, augmentant ainsi la confiance des utilisateurs.

Takeaways

- 😀 Les modèles de langage sont omniprésents et peuvent parfois donner des réponses incroyablement exactes, mais aussi parfois fausses de manière intéressante.

- 😀 L'augmentation par récupération (RAG) est une méthode pour rendre les modèles de langage plus précis et actuels.

- 😀 Les modèles de langage génèrent des réponses en fonction des requêtes des utilisateurs, mais peuvent avoir des comportements indésirables, notamment des informations obsolètes ou sans sources fiables.

- 😀 Marina partage une anecdote où elle a répondu à la question de ses enfants sur la planète ayant le plus de lunes avec des informations obsolètes (Jupiter et 88 lunes).

- 😀 Le problème de l'absence de sources et des informations dépassées peut affecter la qualité des réponses des modèles de langage.

- 😀 Si Marina avait vérifié la réponse auprès d'une source fiable comme la NASA, elle aurait trouvé que Saturne possède actuellement 146 lunes, un nombre en constante évolution.

- 😀 Avec l'augmentation par récupération (RAG), les modèles de langage peuvent accéder à une base de données de contenu externe pour récupérer des informations à jour avant de générer une réponse.

- 😀 Dans le cadre du RAG, le modèle de langage effectue une recherche dans la base de données, récupère les informations pertinentes, puis génère une réponse fondée sur ces données.

- 😀 RAG aide à résoudre deux problèmes principaux des modèles de langage : les informations obsolètes et l'absence de sources fiables.

- 😀 Grâce au RAG, les modèles peuvent être mis à jour facilement avec de nouvelles informations sans avoir besoin de retrainer le modèle complet.

- 😀 Le RAG permet également au modèle de langage de donner des preuves pour justifier ses réponses, réduisant ainsi la probabilité de générer des hallucinations ou des informations erronées.

Q & A

Qu'est-ce que les modèles de langage de grande taille (LLM) et comment fonctionnent-ils ?

-Les modèles de langage de grande taille (LLM) sont des modèles d'IA qui génèrent du texte en réponse à des requêtes des utilisateurs. Ils sont entraînés sur de vastes ensembles de données et peuvent générer des réponses convaincantes, mais peuvent aussi produire des réponses incorrectes ou obsolètes.

Quel est le principal problème des modèles de langage lorsqu'ils génèrent des réponses ?

-Le principal problème est que ces modèles peuvent fournir des réponses incorrectes ou obsolètes, car ils s'appuient uniquement sur les informations apprises pendant leur entraînement, sans se mettre à jour avec de nouvelles données.

Quelle solution propose Marina Danilevsky pour améliorer la précision des réponses des modèles de langage ?

-Marina Danilevsky propose l'utilisation du cadre Retrieval-Augmented Generation (RAG), qui permet d'intégrer une source de contenu externe afin de récupérer des informations actualisées avant de générer une réponse.

En quoi consiste le processus Retrieval-Augmented Generation (RAG) ?

-Le processus RAG consiste à faire en sorte que le modèle de langage récupère d'abord des informations pertinentes dans une base de données externe (ou Internet), puis utilise ces informations pour générer une réponse plus précise et actualisée.

Comment un modèle de langage traditionnel répondrait-il à une question sur le nombre de lunes de Jupiter ?

-Un modèle de langage traditionnel pourrait répondre de manière confiante que Jupiter possède 88 lunes, même si cette information est obsolète, car il ne dispose pas de mécanisme pour se mettre à jour avec de nouvelles données.

Que se passe-t-il lorsqu'un modèle de langage utilise la méthode RAG pour répondre à une question ?

-Avec RAG, le modèle de langage récupère d'abord les informations pertinentes, les combine avec la question de l'utilisateur, puis génère une réponse basée sur des données à jour, fournissant ainsi des preuves pour soutenir sa réponse.

Quels sont les deux problèmes majeurs que RAG aide à résoudre dans le contexte des modèles de langage ?

-RAG aide à résoudre deux problèmes majeurs : l'obsolescence des informations et le manque de sources fiables. Il permet de récupérer des données actualisées et de citer des sources pour justifier la réponse générée.

Pourquoi est-il important pour un modèle de langage de donner des réponses basées sur des sources fiables ?

-Donner des réponses basées sur des sources fiables réduit le risque d'hallucinations (réponses inventées) et garantit que l'information fournie est correcte et vérifiable, ce qui renforce la crédibilité du modèle.

Quels sont les défis liés à la récupération d'informations pour les modèles de langage dans le cadre de RAG ?

-Un défi majeur est que la qualité des informations récupérées dépend de la performance du système de récupération. Si la récupération d'informations n'est pas optimale, le modèle pourrait ne pas obtenir les meilleures données pour répondre correctement à une question.

Quel rôle joue l'amélioration continue des systèmes de récupération d'informations dans la méthode RAG ?

-L'amélioration continue des systèmes de récupération est cruciale pour garantir que le modèle ait accès aux meilleures informations possibles, ce qui améliore la qualité des réponses générées et réduit le risque d'erreurs ou de données obsolètes.

Outlines

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantMindmap

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantKeywords

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantHighlights

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantTranscripts

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantVoir Plus de Vidéos Connexes

Accelerating LLM family of models on Arm Neoverse based Graviton AWS processors with KleidiAI

Les algorithmes | 2 minutes d'IA

Mindblowing Research That Will Change The Way You Use LLMs

Palantir AI Military Demo Is Actually Scary

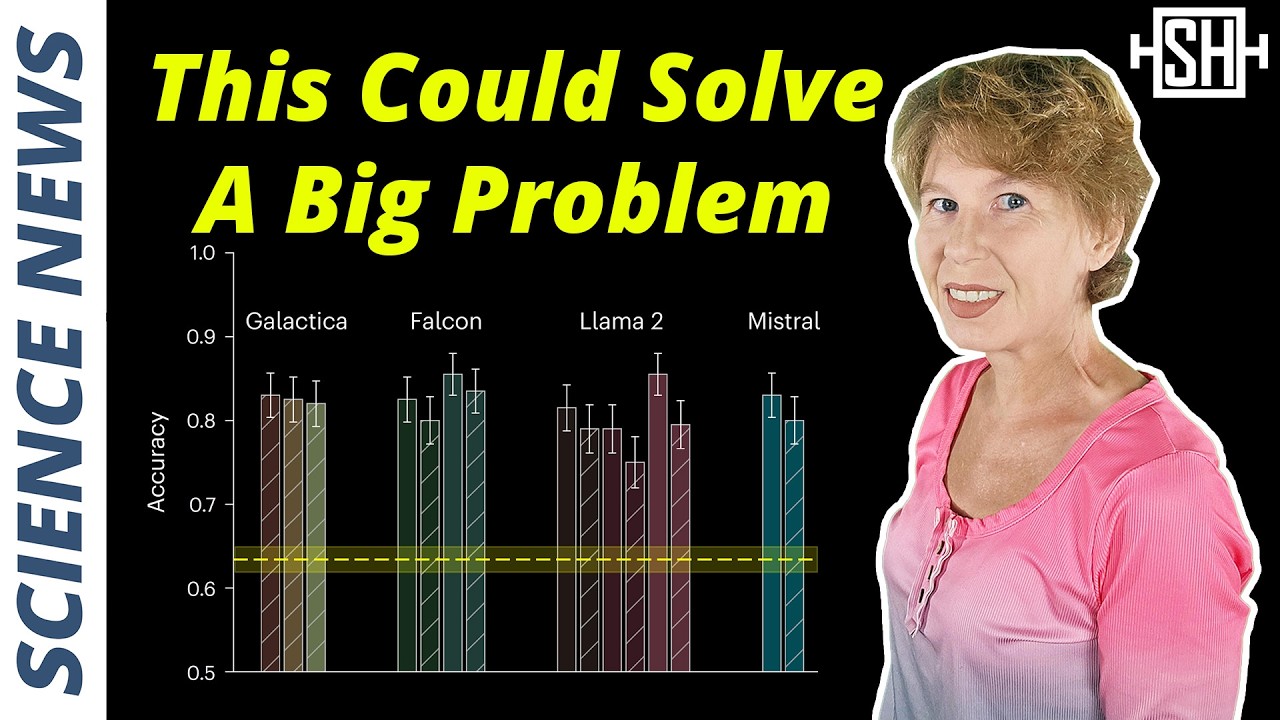

AIs Predict Research Results Without Doing Research

02 Một nhà khoa học dữ liệu làm những công việc gì

Best Presta Gauge | Mountain Bike Tire Pressure Gauges

5.0 / 5 (0 votes)