Inteligencia Artificial y Seguridad

Summary

TLDRLa seguridad en la inteligencia artificial (IA) es crucial para generar confianza en los datos y modelos. La IA mal diseñada puede ser perjudicial, por lo que es fundamental abordar la seguridad desde el inicio. La investigación busca vulnerabilidades en modelos para prevenir ataques maliciosos, como el hackeo de algoritmos que podría causar caos, como en el tráfico. Es importante validar datos y evitar el aprendizaje en línea para proteger la integridad del sistema. Los algoritmos deben ser robustos frente a manipulaciones, como el engaño en detección de personas. La IA impacta nuestra vida diaria y requiere técnicas seguras para prevenir fallas, según el nivel de riesgo y criticidad del sistema.

Takeaways

- 🔒 La seguridad es un aspecto fundamental en la inteligencia artificial, especialmente en la protección de datos y modelos.

- 📈 Es necesario generar confianza en la calidad de la información manejada y entender los niveles de seguridad y confianza que se pueden establecer.

- 🛡️ La seguridad debe ser considerada desde el principio en el diseño de sistemas de inteligencia artificial para evitar consecuencias catastróficas.

- 🔎 Hay una gran cantidad de investigación en curso para encontrar vulnerabilidades en los modelos de IA y prevenir su explotación por intentos maliciosos.

- ⚠️ La seguridad es crucial tanto para la empresa proveedora del producto o servicio como para el usuario final.

- 🚦 Un ejemplo cotidiano mencionado es el sistema de tránsito optimizado por un algoritmo; su hackeo podría causar caos en la circulación.

- 🕵️♂️ Se debe comprender qué características o actividades pueden ser utilizadas para engañar o hackear los modelos de IA.

- 👚 El caso de la detección de personas con patrones en remeras demuestra la complejidad de engañar a los algoritmos y las vulnerabilidades que pueden tener.

- 🔄 La validación de datos y el entrenamiento seguro de modelos son esenciales para evitar la corrupción de sistemas por datos falsos.

- 🛠️ La IA se utiliza en múltiples aspectos de la vida y requiere técnicas de seguridad variadas según el nivel de riesgo y criticidad.

- 🔄 La implementación de sistemas redundantes y la toma de decisiones seguras es esencial para garantizar la fiabilidad de la IA en operaciones críticas.

Q & A

¿Qué es la seguridad en el contexto de la inteligencia artificial?

-La seguridad en la inteligencia artificial se refiere a la protección de los datos y los modelos contra vulnerabilidades y ataques maliciosos, asegurando la calidad y confianza de la información manejada.

¿Por qué es importante hablar de seguridad en datos y modelos de IA?

-Es fundamental porque si la IA no está bien diseñada desde el principio y no considera estos aspectos, puede transformarse en algo catastrófico, mucho peor que una IA mal entrenada o mal diseñada.

¿Qué investigación se está realizando en relación con la seguridad de los modelos de IA?

-Se está investigando para encontrar las vulnerabilidades que pueden tener estos modelos y cómo prevenir que sean hackeados o manipulados por intenciones maliciosas.

¿Qué riesgos implicaría un ataque a un modelo de IA utilizado en el tránsito?

-Un ataque a un modelo de IA en el tránsito podría generar caos absoluto, como por ejemplo, al alterar el algoritmo para optimizar rutas, lo que afectaría tanto a la empresa proveedora como al usuario final.

¿Cómo pueden los hackers afectar la detección de personas en sistemas de IA?

-Los hackers podrían afectar la detección de personas al introducir datos falsos en el sistema o al usar técnicas específicas, como patrones en la ropa, que engañan a los detectores de personas.

¿Qué estrategias se pueden usar para mejorar la seguridad de los algoritmos de aprendizaje en línea?

-Se pueden usar estrategias como validar los datos con los que se entrenan los modelos y evitar el aprendizaje en línea en favor de un entrenamiento más controlado y seguro.

¿Qué caso de investigación se menciona en el guion sobre vulnerabilidades de algoritmos de detección de personas?

-Se menciona un caso en el que un grupo de investigación identificó vulnerabilidades en algoritmos de detección de personas al usar patrones en las remeras que impedían al algoritmo encontrar personas.

¿Cómo la IA puede tener un impacto transversal en nuestra vida cotidiana?

-La IA impacta de manera transversal en nuestra vida al influir en la selección de noticias, música, y hasta en el funcionamiento de vehículos autónomos, utilizando técnicas y sistemas de seguridad variados según el nivel de riesgo y criticidad.

¿Qué es 'steady planning' y cómo se relaciona con la detección de personas en IA?

-El 'steady planning' se refiere a la estrategia de búsqueda de características específicas que el algoritmo busca para identificar y localizar a las personas, lo cual es crucial para prevenir su manipulación por hackers.

¿Cómo la IA puede ser utilizada con buenos fines para protegernos y defendernos?

-La IA puede ser utilizada con buenos fines al aplicarla en sistemas de seguridad, análisis de datos para predecir y prevenir riesgos, y en la toma de decisiones más informadas que benefician a la sociedad.

Outlines

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantMindmap

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantKeywords

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantHighlights

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantTranscripts

Cette section est réservée aux utilisateurs payants. Améliorez votre compte pour accéder à cette section.

Améliorer maintenantVoir Plus de Vidéos Connexes

Road Danger Prediction: Classic Models, AI Models and Data Challenges

Accelerate the value of generative AI with three secret ingredients

Dilema Ético de la Inteligencia Artificial

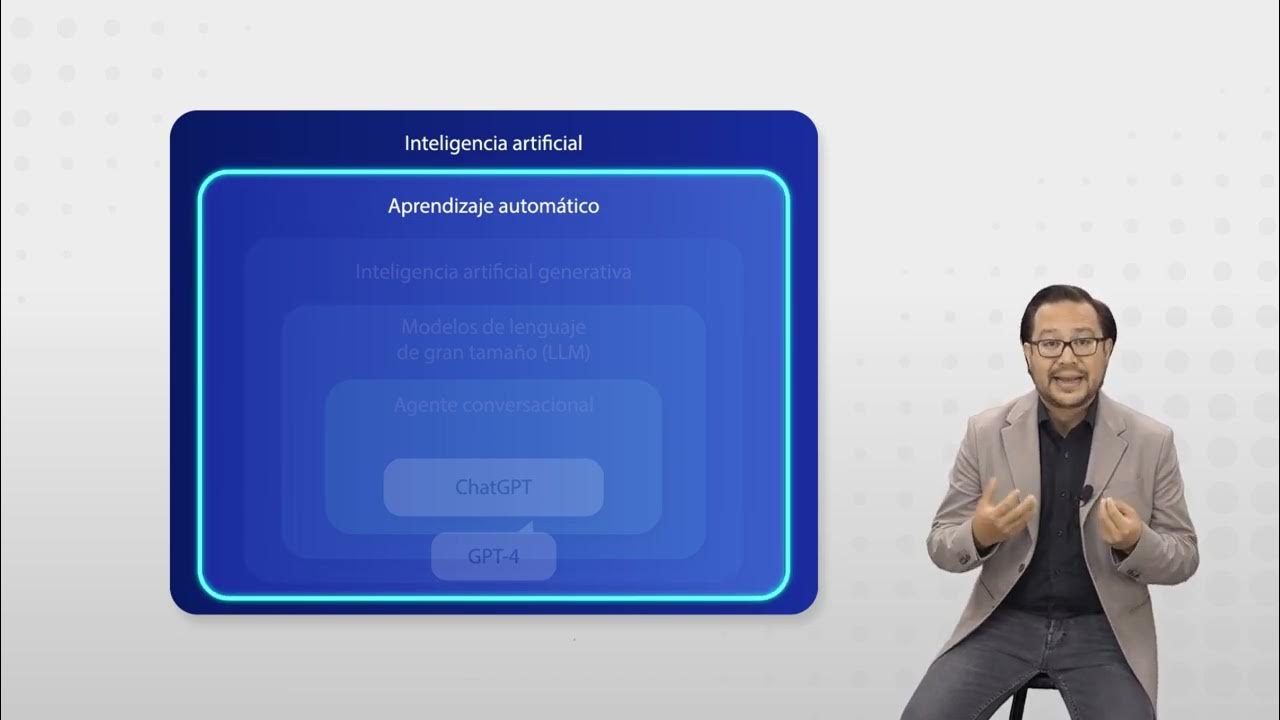

Qué es Inteligencia Artificial Generativa?

26. Sala 25. 3º. Tácticas y técnicas de IA para equipos azules y rojos -David Barroso (Countercraft)

Inteligencia Artificial en la Moda | #StoryTimeFashionEdition

5.0 / 5 (0 votes)