Fine-tuning Multimodal Models (CLIP) with DataChain to Match Cartoon Images to Joke Captions

Summary

TLDRВ этом видео объясняется процесс тонкой настройки модели с использованием библиотеки DataChain, которая помогает работать с многомодальными данными. Пример демонстрирует, как модель быстро учится на небольшой выборке из 10 образцов, что приводит к быстрому снижению потерь. Однако, несмотря на это, модель переобучается, и автор подчеркивает, что для реальных применений следует использовать другие данные для проверки. Основная цель демонстрации — показать, как работает процесс тонкой настройки и как библиотека DataChain помогает в обработке данных.

Takeaways

- 😀 Быстрое тонкое подстроение модели на маленьком наборе данных приводит к значительному снижению ошибки, но может привести к переобучению.

- 😀 Использование всего 10 образцов данных демонстрирует эффективность быстрого обучения, но в реальных условиях это может быть неприемлемо.

- 😀 Процесс тонкой настройки полезен для демонстрации, но не стоит использовать его для реальных предсказаний в сложных задачах.

- 😀 В реальных сценариях для оценки модели рекомендуется использовать отдельную тестовую выборку, а не ту же самую, что была использована для обучения.

- 😀 Оценка модели после тонкой настройки показала значительное улучшение точности (с 0.17 до почти 100% на малом наборе данных).

- 😀 Пример с DataChain подчеркивает, как можно эффективно работать с мультимодальными данными, включая текст и изображения.

- 😀 Тонкая настройка на малом наборе данных хорошо работает для специфических задач, но не стоит ожидать универсальной применимости для всех типов данных.

- 😀 DataChain упрощает обработку и анализ мультимодальных данных, что полезно для таких приложений, как captioning и другие задачи машинного обучения.

- 😀 Демонстрация показала, как тонкая настройка модели может быть использована для более точной подгонки под данные, но требует осторожности в реальных приложениях.

- 😀 Видео иллюстрирует, как тонкая настройка может улучшить производительность модели, но важна осторожность в использовании для сложных, неограниченных данных.

Q & A

Что такое fine-tuning и как он работает в контексте модели?

-Fine-tuning — это процесс дообучения модели на небольшом наборе данных после её первоначального обучения на большом объёме данных. В контексте видео модель быстро адаптируется к небольшому набору данных, что позволяет ей снизить потерю (loss) и достичь почти идеальных результатов на этих данных.

Почему использование всего 10 образцов данных не является хорошей практикой для реальных задач?

-Использование всего 10 образцов данных может привести к переобучению модели, когда она хорошо работает только на этих данных, но плохо обобщает на новые примеры. В реальных задачах необходимо больше данных, чтобы модель могла лучше обобщать и работать с разнообразными случаями.

Какие показатели улучшаются после fine-tuning модели?

-После fine-tuning модели наблюдается значительное снижение значения потерь (loss) и увеличение вероятности правильных предсказаний. Например, в видео вероятность правильных предсказаний на обучающих данных увеличивается до почти идеальных значений.

Какова цель демонстрации fine-tuning в этом видео?

-Цель демонстрации — показать, как работает процесс fine-tuning и как библиотека DataChain помогает обрабатывать данные и работать с мультимодальными наборами данных. Это позволяет понять, как можно адаптировать модели к специфическим данным.

Что такое библиотека DataChain и как она помогает в работе с данными?

-DataChain — это библиотека, которая помогает обрабатывать мультимодальные данные и ускоряет процессы работы с ними, такие как предобучение и дообучение моделей. В видео она используется для упрощения работы с обучающими данными и мультимодальными задачами.

Как можно улучшить модель после её fine-tuning на небольшом наборе данных?

-Для улучшения модели необходимо использовать более разнообразные и объёмные наборы данных для обучения, чтобы модель могла обобщать и работать с различными примерами, а не только с теми, на которых она была дообучена.

Какие проблемы могут возникнуть при использовании обучающей выборки, состоящей только из 10 образцов?

-Проблемы включают переобучение модели, что приводит к её высокой точности на небольшом наборе данных, но плохой производительности на новых данных. Также может возникнуть недостаток обобщающей способности модели, что снижает её применимость в реальных условиях.

Что важно помнить при оценке модели после её дообучения?

-Важно помнить, что оценку модели следует проводить не на тех же данных, которые использовались для обучения, чтобы избежать переобучения. В реальных сценариях необходимо использовать отложенную выборку данных, чтобы объективно оценить производительность модели.

Что такое CLIP similarity и как это используется в видео?

-CLIP similarity — это метод для оценки сходства между текстовыми и визуальными данными, используя модель CLIP. В видео он используется для вычисления вероятностей меток на основе обновлённой модели после её fine-tuning.

Какие ограничения следует учитывать при использовании fine-tuned модели на реальных данных?

-При использовании fine-tuned модели на реальных данных важно помнить, что модель может быть настроена только на небольшой набор примеров, что ограничивает её способность обрабатывать более сложные и разнообразные данные. Для реальных задач необходимо дообучать модель на более широком наборе данных и проводить тщательную валидацию на новых примерах.

Outlines

此内容仅限付费用户访问。 请升级后访问。

立即升级Mindmap

此内容仅限付费用户访问。 请升级后访问。

立即升级Keywords

此内容仅限付费用户访问。 请升级后访问。

立即升级Highlights

此内容仅限付费用户访问。 请升级后访问。

立即升级Transcripts

此内容仅限付费用户访问。 请升级后访问。

立即升级浏览更多相关视频

Context Engineering is the New Vibe Coding (Learn this Now)

Recipe App UI SwiftUI - Full Episode

ArchiCAD 25 - TWINMOTION 2021.1.4. Где скачать плагин, как импортировать и работать.

Как начать ДРОПШИППИНГ с нуля на Shopify в 2025 | ПОЛНОЕ РУКОВОДСТВО

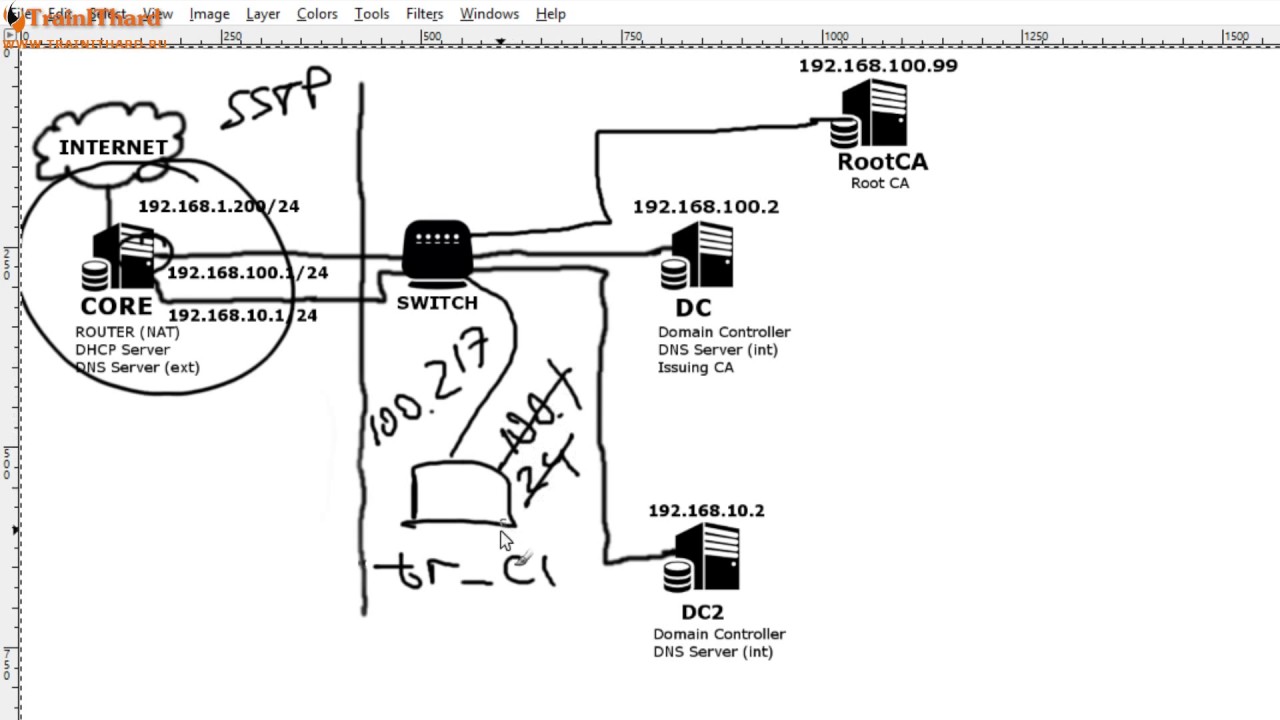

[Windows Server 2012 basics] Микроурок 11.5 - Настройка SSTP VPN

Easiest Way to Downshift Smoothly - Works in Every Manual Car

GPT-4o - анализ графиков, рынка и стратегий на Python / OpenAI GPT-4o Python Tutorial @AVKlimov

5.0 / 5 (0 votes)