La REGRESIÓN LINEAL en el Machine Learning

Summary

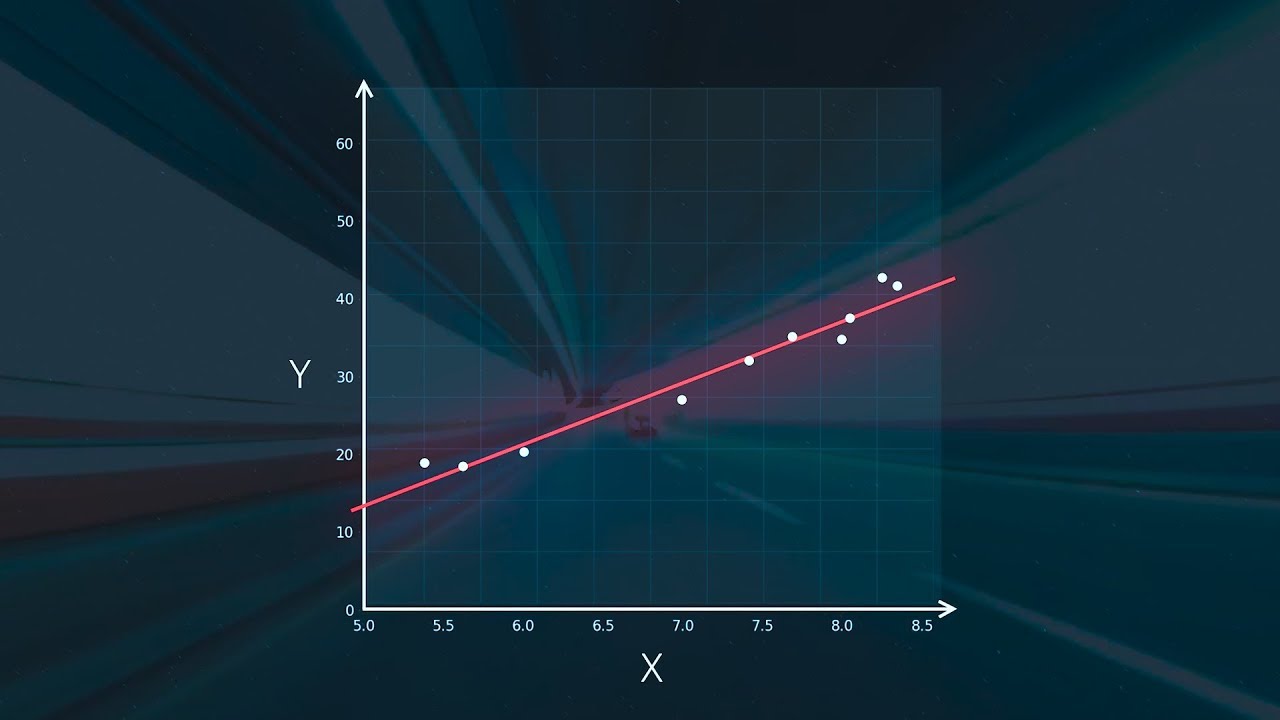

TLDREn este video de Coding Beats, se explica el algoritmo de regresión lineal, uno de los métodos fundamentales en aprendizaje automático. Se describe cómo este algoritmo ajusta una línea recta para representar la relación entre dos variables de un conjunto de datos. Se profundiza en cómo el algoritmo utiliza la **Error Cuadrático Medio (MSE)** para evaluar la precisión del ajuste y cómo el **descenso de gradiente** se utiliza para minimizar este error, encontrando la mejor línea que se ajusta a los datos. El video ofrece una explicación clara y accesible para entender estos conceptos clave de manera intuitiva.

Takeaways

- 😀 El algoritmo de regresión lineal busca encontrar una línea recta que represente de manera matemática una serie de datos con una relación lineal.

- 😀 La regresión lineal se basa en la ecuación de una línea recta: y = wx + b, donde 'w' es la pendiente y 'b' es la intersección con el eje Y.

- 😀 La pendiente ('w') representa la inclinación de la recta. Cuanto mayor sea la pendiente, más empinada será la línea.

- 😀 El valor de 'b' indica en qué punto la línea corta el eje Y cuando 'x' es igual a 0.

- 😀 El objetivo del algoritmo es encontrar automáticamente los valores de 'w' y 'b' que mejor se ajusten a los datos.

- 😀 La función de error más utilizada para medir el ajuste de la línea es el error cuadrático medio (ECM), también conocido como función de costo.

- 😀 El ECM mide la diferencia entre los puntos reales de los datos y los puntos predichos por la línea de regresión, promediando esas diferencias.

- 😀 El término 'cuadrado' en el ECM se utiliza para evitar que las diferencias positivas y negativas se cancelen entre sí.

- 😀 El objetivo es minimizar el ECM, lo que significa encontrar los valores de 'w' y 'b' que minimicen el error entre los datos y la línea de regresión.

- 😀 El proceso de optimización para encontrar estos valores se realiza mediante el método de descenso de gradiente.

- 😀 Con el descenso de gradiente, se ajustan progresivamente los valores de 'w' y 'b', y la línea se ajusta mejor a los datos con cada iteración, reduciendo el error.

Q & A

¿Qué es el algoritmo de regresión lineal?

-El algoritmo de regresión lineal busca encontrar una línea recta que represente la relación entre dos variables, ajustándose lo mejor posible a un conjunto de datos para hacer predicciones sobre la variable dependiente a partir de la independiente.

¿Cómo se representa la relación entre las variables en el gráfico de regresión lineal?

-En el gráfico, la variable independiente se encuentra en el eje horizontal (x) y la variable dependiente en el eje vertical (y). La regresión lineal busca una línea recta que se ajuste a los puntos de datos de manera que minimice el error de ajuste.

¿Qué significa el parámetro 'w' en la ecuación de la recta?

-'w' representa la pendiente de la línea recta, indicando cuán inclinada está la recta respecto al eje horizontal. Una mayor pendiente implica que la recta sube más rápidamente, mientras que una pendiente más baja indica una recta más horizontal.

¿Qué representa el parámetro 'b' en la ecuación de la regresión lineal?

-El parámetro 'b' representa el punto de intersección de la recta con el eje vertical (cuando x = 0), es decir, el valor de y cuando la variable independiente es cero.

¿Qué función se utiliza para medir la calidad del ajuste de la regresión lineal?

-La función que se utiliza para medir la calidad del ajuste es el 'error cuadrático medio' (ECM), que calcula la diferencia entre los puntos de datos reales y los puntos estimados por la línea de regresión, y luego promedia esas diferencias elevadas al cuadrado.

¿Por qué se utiliza el cuadrado de la diferencia en el cálculo del error?

-El cuadrado de la diferencia se utiliza para evitar la cancelación de valores positivos y negativos. Al elevar las diferencias al cuadrado, se penalizan más las grandes discrepancias y se asegura que todas las diferencias contribuyan positivamente al error total.

¿Qué significa minimizar el error cuadrático medio en la regresión lineal?

-Minimizar el error cuadrático medio implica encontrar los valores de los parámetros 'w' y 'b' que hacen que la recta de regresión se ajuste lo mejor posible a los datos, es decir, reducir al máximo la diferencia entre los puntos reales y los estimados.

¿Cómo se logra encontrar los valores óptimos de 'w' y 'b' en la regresión lineal?

-Los valores óptimos de 'w' y 'b' se encuentran mediante un proceso de optimización, utilizando métodos como el descenso de gradiente. Este proceso ajusta iterativamente los valores de 'w' y 'b' para minimizar el error cuadrático medio.

¿Qué es el método de descenso de gradiente?

-El descenso de gradiente es un algoritmo de optimización que se utiliza para minimizar una función de error. En el caso de la regresión lineal, ajusta los parámetros 'w' y 'b' gradualmente, tomando pasos más pequeños hacia el mínimo de la función de error en cada iteración.

¿Qué ocurre con la recta de regresión a medida que se aplican más iteraciones del descenso de gradiente?

-A medida que se aplican más iteraciones del descenso de gradiente, la recta de regresión se ajusta progresivamente mejor a los datos. El error disminuye en cada iteración, lo que permite que la recta se acerque más a la distribución real de los puntos de datos.

Outlines

Этот раздел доступен только подписчикам платных тарифов. Пожалуйста, перейдите на платный тариф для доступа.

Перейти на платный тарифMindmap

Этот раздел доступен только подписчикам платных тарифов. Пожалуйста, перейдите на платный тариф для доступа.

Перейти на платный тарифKeywords

Этот раздел доступен только подписчикам платных тарифов. Пожалуйста, перейдите на платный тариф для доступа.

Перейти на платный тарифHighlights

Этот раздел доступен только подписчикам платных тарифов. Пожалуйста, перейдите на платный тариф для доступа.

Перейти на платный тарифTranscripts

Этот раздел доступен только подписчикам платных тарифов. Пожалуйста, перейдите на платный тариф для доступа.

Перейти на платный тарифПосмотреть больше похожих видео

Cómo identificar el OVERFITTING en tu RED NEURONAL - Parte 2

Regresión Lineal y Mínimos Cuadrados Ordinarios | DotCSV

Llenado de datos de series - Metodo de correlacion ortogonal

Las Redes Neuronales... ¿Aprenden o Memorizan? - Overfitting y Underfitting - Parte 1

REGRESIÓN LINEAL MÚLTIPLE FACIL | SPSS | SUPUESTOS, CUÁNDO Y CÓMO USARLA (JERÁRQUICA, POR PASOS)

¿Qué es el Descenso del Gradiente? Algoritmo de Inteligencia Artificial | DotCSV

5.0 / 5 (0 votes)