[SER222] Empirical Analysis (6/8): Predicting and Validating ThreeSum

Summary

TLDREn este video, se discute cómo tomar el modelo obtenido de un conjunto de datos y verificar si realmente es el que se desea, es decir, realizar una predicción y luego validar el resultado. Se habla de cómo se creó la función T(n) para modelar el tiempo de ejecución del programa Three-Sum a partir de datos de referencia. Se hace una predicción para un nuevo tamaño de conjunto de datos y se compara con el tiempo real de ejecución. Aunque hay una pequeña diferencia, se considera que el modelo es suficientemente bueno, y se sugiere probar con conjuntos de datos más grandes para asegurar que el error no se incremente de manera significativa.

Takeaways

- 🔍 El vídeo trata sobre cómo validar un modelo creado a partir de un conjunto de datos.

- 📈 Se menciona la creación de una función T(n) que modela el tiempo de ejecución del programa Three-Sum.

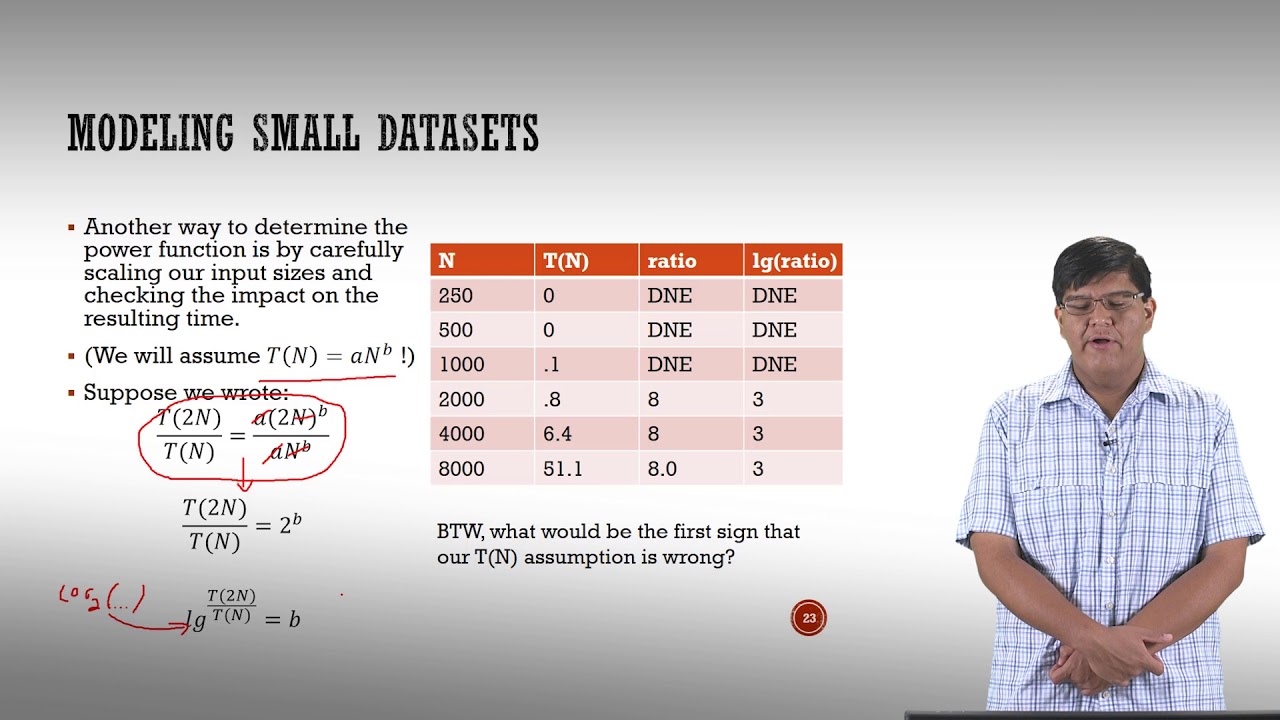

- 💾 Se realizó un benchmarking para generar datos, variando el tamaño de los datos de 250 a 8000.

- 📊 Se utilizó una técnica de regresión para construir la función T(n) que se ajusta bien a los datos existentes.

- ❓ Se plantea la pregunta de si la función T(n) es realmente lo que se desea y si es suficientemente precisa.

- 🔮 Se hace una predicción usando la función T(n) para un nuevo tamaño de conjunto de datos de 16,000 elementos.

- 🕒 La predicción indica que el tiempo de ejecución sería de 410.8 segundos para el nuevo tamaño de datos.

- 🤔 Se sugiere que los datos utilizados para construir el modelo deberían coincidir con la función T(n), ya que de otro modo la regresión no habría funcionado correctamente.

- 📝 Se ejecuta el programa con el nuevo tamaño de datos y se obtiene un tiempo de 408 segundos, lo cual es cercano a la predicción.

- 📉 Se plantea la posibilidad de realizar predicciones para conjuntos de datos aún más grandes para asegurar que la margen de error no se incremente de manera drástica.

Q & A

¿Qué es lo que se quiere discutir en el video?

-El video trata sobre cómo tomar un modelo generado a partir de un conjunto de datos y verificar si realmente es lo que se desea, es decir, realizar una predicción y validar el resultado.

¿Qué función se creó en el video anterior?

-En el video anterior se creó una función T(n) que modela el tiempo de ejecución del programa de tres-sumas.

¿Cómo se generó la función T(n)?

-La función T(n) se generó mediante técnicas de regresión a partir de un conjunto de datos obtenidos a través de benchmarking.

¿Cuál fue el rango de los datos utilizados para crear el modelo T(n)?

-El rango de los datos utilizados para crear el modelo T(n) fue de 250 a 8000.

¿Cuál es la pregunta clave que se busca responder con el modelo T(n)?

-La pregunta clave es si el modelo T(n) realmente es lo que se desea y si es capaz de predecir adecuadamente el tiempo de ejecución.

¿Cómo se hace una predicción con la función T(n)?

-Para hacer una predicción, se evalúa la función T(n) con el tamaño de la siguiente dataset más grande, que en este caso es de 16,000.

¿Cuál fue la predicción del tiempo de ejecución para el dataset de 16,000?

-La predicción del tiempo de ejecución para el dataset de 16,000 fue de 410.8 segundos.

¿Cómo se verifica la precisión de la predicción?

-Se verifica la precisión de la predicción ejecutando el programa con el tamaño de dataset predeterminado y comparando el tiempo real obtenido con la predicción.

¿Cuál fue el tiempo real obtenido al ejecutar el programa con el dataset de 16,000?

-El tiempo real obtenido al ejecutar el programa con el dataset de 16,000 fue de 408 segundos.

¿Es la diferencia entre la predicción y el tiempo real aceptable?

-La diferencia entre la predicción y el tiempo real es mínima, lo que indica que la función T(n) es razonablemente precisa.

¿Qué más se puede hacer para asegurar que la función T(n) sea confiable para datasets más grandes?

-Para asegurar la confiabilidad de la función T(n), se podrían realizar predicciones para datasets aún más grandes, como de 32,000 o 64,000, para verificar si el error se mantiene constante.

¿Qué significa que la función T(n) sea 'suficiente' para los propósitos del video?

-Que la función T(n) sea 'suficiente' significa que puede predecir con una margen de error aceptable el tiempo de ejecución del programa para los datasets considerados.

Outlines

このセクションは有料ユーザー限定です。 アクセスするには、アップグレードをお願いします。

今すぐアップグレードMindmap

このセクションは有料ユーザー限定です。 アクセスするには、アップグレードをお願いします。

今すぐアップグレードKeywords

このセクションは有料ユーザー限定です。 アクセスするには、アップグレードをお願いします。

今すぐアップグレードHighlights

このセクションは有料ユーザー限定です。 アクセスするには、アップグレードをお願いします。

今すぐアップグレードTranscripts

このセクションは有料ユーザー限定です。 アクセスするには、アップグレードをお願いします。

今すぐアップグレード関連動画をさらに表示

Varianza, desviación estándar y coeficiente de variación en Excel

45. Programación en C++ || Cadenas || Invertir una cadena - Función strrev()

[SER222] Empirical Analysis (7/8): Modeling Small Datasets

El Subdesarrollo - Eduardo Galeano (audio mejorado)

Comprobación de una Integral indefinida │Integral algebraica *

Análisis discriminante en R

5.0 / 5 (0 votes)