The Social Dilemma – Bonus Clip: The Discrimination Dilemma

Summary

TLDREl guion del video destaca la falta de objetividad en los algoritmos y cómo la tecnología emergente perpetúa el sesgo. Los algoritmos, optimizados para un éxito definido, utilizan datos históricos para predecir futuros, lo que puede perpetuar patrones discriminatorios. Se menciona la falta de comprensión gubernamental y regulación que mitiguen estos problemas. Se identifican cuatro categorías de algoritmos que pueden causar daño: financieros, relacionados con la libertad, el sustento y la información. Se enfatiza que estos algoritmos, en lugar de predecir el futuro, lo causan, y existe una preocupación por la opacidad y el daño que pueden generar.

Takeaways

- 🤖 Los algoritmos no son objetivos y pueden perpetuar sesgos al usar datos históricos para predecir el éxito futuro.

- 🔍 La falta de comprensión gubernamental sobre estas tecnologías emergentes lleva a una ausencia de regulación y leyes para mitigar los problemas de la IA.

- 🚫 La creencia errónea de que los algoritmos son inherentemente justos y objetivos impide cuestionarlos y, por tanto, detectar su sesgo.

- 🏦 Los algoritmos financieros influyen en decisiones cruciales como la concesión de seguros, créditos, hipotecas y alojamiento.

- 🔒 Los algoritmos relacionados con la libertad pueden determinar la policía que recibes, la duración de tu encarcelamiento y si te quedas en prisión pendiente de juicio.

- 💼 Los algoritmos de sustento afectan tu empleo, si obtienes una entrevista, si te dan el trabajo, si te dan un aumento y las horas que trabajas.

- 📊 Un ejemplo de un algoritmo de contratación sesgado fue uno que favoreció desproporcionadamente a individuos con nombres como 'Jared' y que jugaban al lacrosse.

- 📰 Los algoritmos también controlan la información que recibimos, lo que puede afectar nuestra percepción política y ser a menudo injusto e ilegal.

- 🚨 La falta de capacidad para hacer cumplir las leyes antidiscriminatorias es un problema crítico en la era de la IA.

- ⚠️ El miedo a un futuro distópico donde los algoritmos opacos y dañinos predeterminan el fracaso de las personas desde el nacimiento.

Q & A

¿Por qué no son objetivos los algoritmos según el guion?

-Los algoritmos no son objetivos porque están optimizados para algún definición de éxito y utilizan datos históricos para predecir futuros éxitos, lo que puede perpetuar los prejuicios y patrones existentes en los datos.

¿Qué problemas surgen cuando las personas creen que los algoritmos son justos y objetivos?

-Cuando las personas creen en la objetividad de los algoritmos, no cuestionan su funcionamiento, lo que puede llevar a que perpetúen y amplíen los prejuicios y patrones discriminatorios presentes en los datos utilizados.

¿Qué son algunos de los sectores en los que los algoritmos pueden estar causando problemas según el guion?

-Los sectores mencionados incluyen finanzas, libertad, sustento y la información. Estos algoritmos pueden influir en aspectos como la concesión de seguros, créditos, vivienda, la duración de la encarcelación, la obtención de empleo y los horarios de trabajo, y la difusión de información política.

¿Cómo pueden los algoritmos de crédito afectar a las personas según el guion?

-Los algoritmos de crédito pueden 'tachar' a las personas basándose en su historial y mostrarles tarjetas de crédito que consideran que 'merecen', lo que puede perpetuar la desigualdad y la discriminación.

¿Qué ejemplo específico se menciona en el guion sobre un algoritmo de contratación que favorece a ciertos individuos?

-Se menciona un algoritmo de contratación que desproporcionadamente favorecía a individuos llamados Jared y que jugaban al lacrosse, ya que la mayoría de los empleados que habían tenido éxito en la empresa tenían esas dos características.

¿Qué es lo que el guion teme en relación con el futuro y los algoritmos?

-El guion teme un futuro distópico donde los algoritmos opacos y perjudiciales no se detengan, y donde se prediga y se asegure que las personas no tengan éxito en la vida, afectando su educación, empleo y acceso a créditos.

¿Qué implicaciones sociales pueden tener los algoritmos según el guion?

-Los algoritmos pueden tener implicaciones sociales graves, como la perpetuación de la discriminación, la falta de oportunidades equitativas y la creación de ciclos de desventaja que son difíciles de romper.

¿Cuáles son las cuatro categorías de algoritmos que pueden causar daño a la sociedad según el guion?

-Las cuatro categorías son: financieras, relacionadas con la libertad, de sustento y de información, cada una afectando aspectos cruciales de la vida de las personas.

¿Por qué los algoritmos pueden ser considerados ilegales según el guion?

-Los algoritmos pueden ser considerados ilegales cuando perpetúan la discriminación y violan leyes de anti-discriminación, pero la aplicación y el cumplimiento de estas leyes en el ámbito de los algoritmos aún no están claros.

¿Qué solución propone el guion para abordar los problemas causados por los algoritmos?

-El guion sugiere la necesidad de comprender y regular los algoritmos para evitar su uso indebido y mitigar los daños que pueden causar a la sociedad.

Outlines

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraMindmap

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraKeywords

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraHighlights

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraTranscripts

Esta sección está disponible solo para usuarios con suscripción. Por favor, mejora tu plan para acceder a esta parte.

Mejorar ahoraVer Más Videos Relacionados

La lucha contra los prejuicios de los algoritmos

Tecnologia Educativa Vs México del siglo XXI (una visión de la realidad actual)

The Future of Tourism: Ian Yeoman at TEDxGroningen

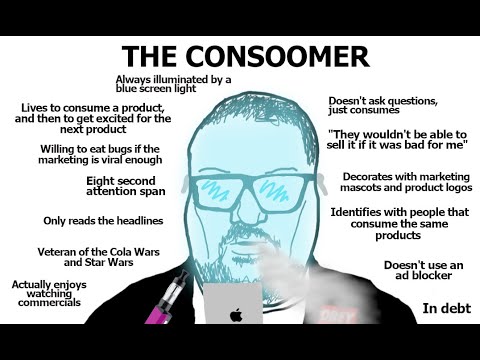

Remember to Consoom Next Content on YouTube®️

Qué son los algoritmos y cómo aprenden de nosotros | BBC Mundo

Inteligencia Artificial VS Diseñador Gráfico (QUÉDATE AL FINAL) | Geekformante

DIBUJO DIGITAL U1 C1 2

5.0 / 5 (0 votes)